雨云GPU云服务器搭建自己的”ChatGPT“—GPT4All本地部署,大语言模型搭建教程。雨云GPU云服务器使用教程。

什么是GPT4All

GPT4All是Nomic AI公司开源的一个类似ChatGPT的模型,它是基于MetaAI开源的LLaMA微调得到的其最大的特点是开源,并且其4-bit量化版本可以在CPU上运行!GPT4All是在大量干净数据上训练的一个开源聊天机器人的生态系统。它不用科学上网!甚至可以不联网!本地就能用。接下来咱们就是实战一下如何体验GPT4All。支持的系统包括Mac/OSX、Windows、Ubuntu市面上常用的所有操作系统。

GPT4All模型是一个3GB – 8GB的文件,您可以下载并插入GPT4All开源生态系统软件。特别强调是GPT4All是遵循非商业化协议,所以不能用于商业用途。

准备

首先需要一台GPU云服务器,这里推荐雨云的GPU云服务器:

雨云优惠注册地址:https://rain.zeruns.com/?s=vpszj

优惠码:zeruns

使用优惠码注册后绑定微信可获得5折优惠券

雨云P40显卡云服务器上线了!8核8G内存 4G显存 25兆 仅需168元/月:https://blog.zeruns.com/archives/766.html

其他云服务器推荐:https://blog.zeruns.com/archives/383.html

注册完账号后进到雨云控制台,云服务器入口可以在后台的 总览 和 云产品 部分找到:

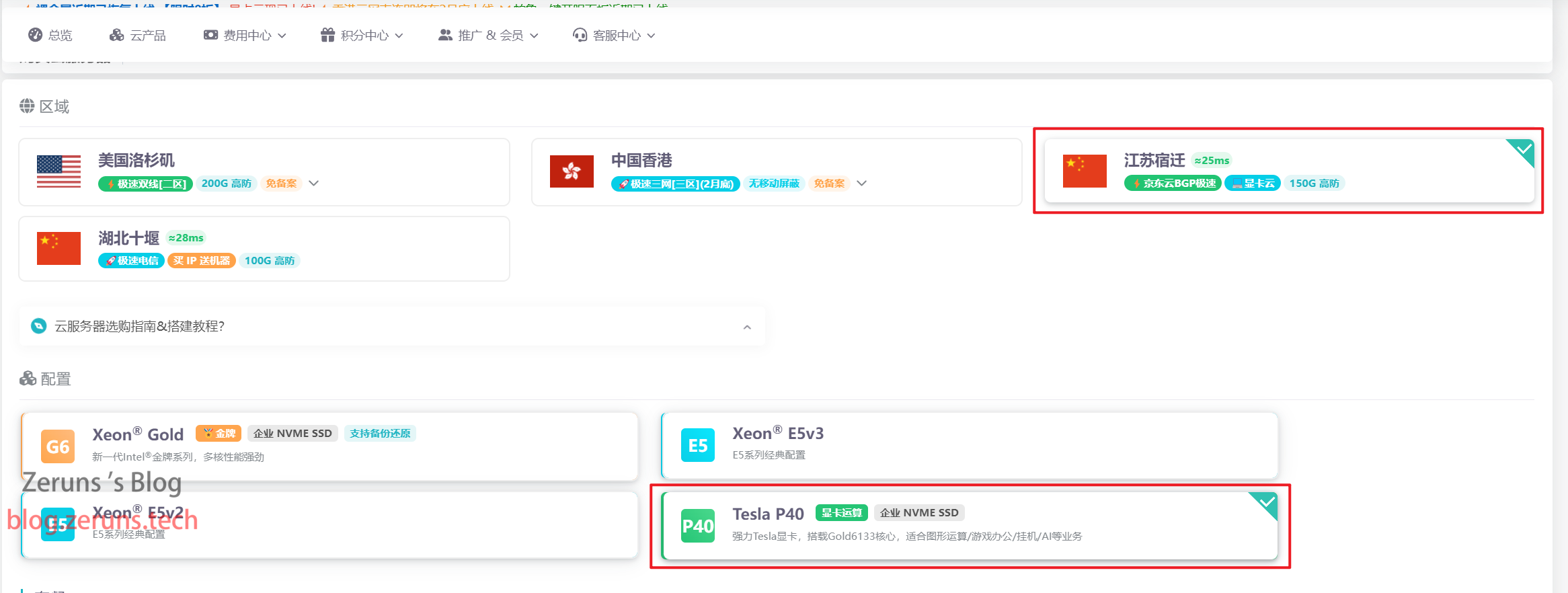

点击购买云服务器,区域选择江苏宿迁,配置选择Tesla P40。

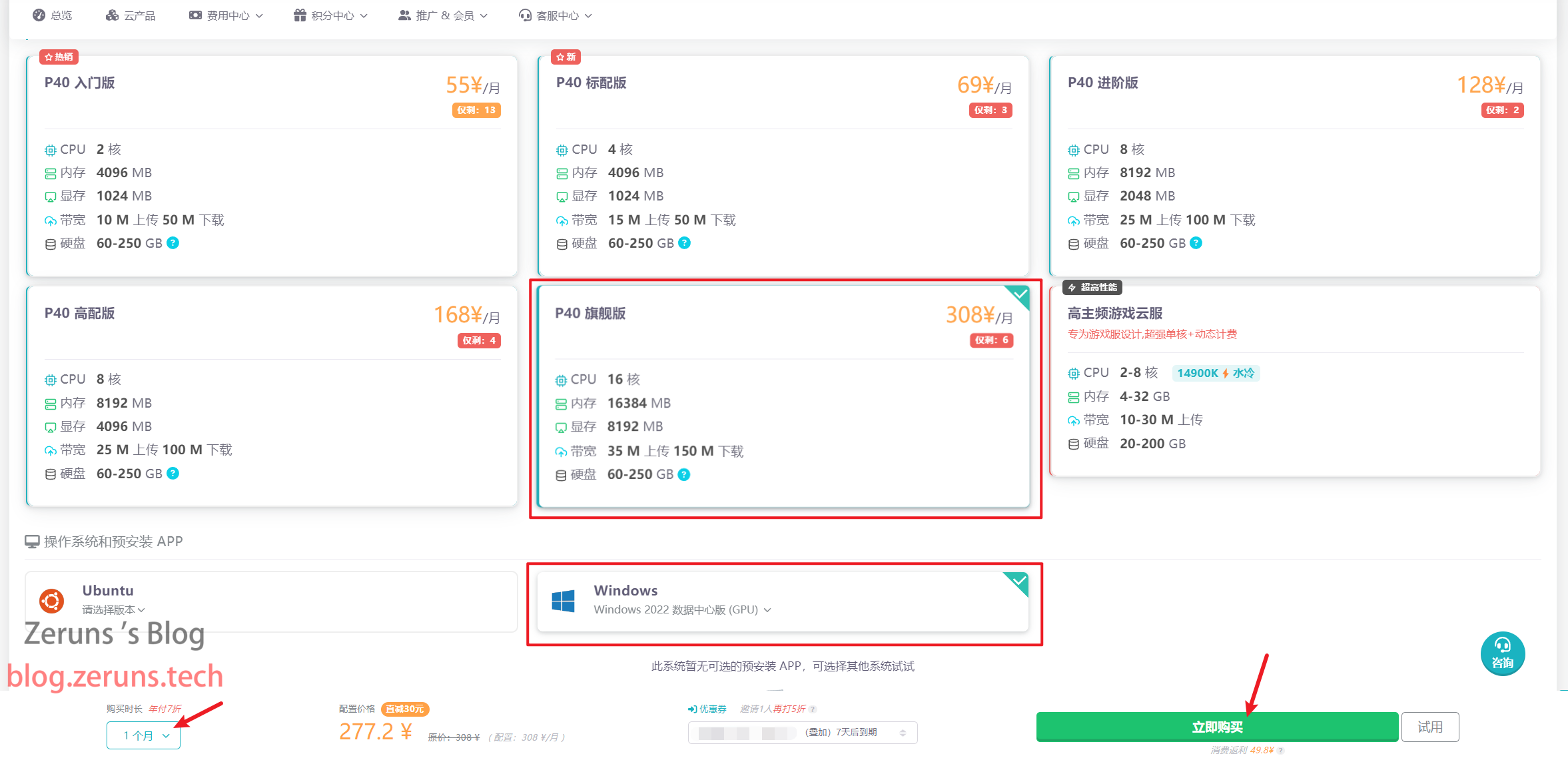

套餐建议选择旗舰版,因为很多AI模型要求最少8G内存/显存,系统选Windows。

选好后点立即购买,也可以点试用,显卡云可以5元试用一天。

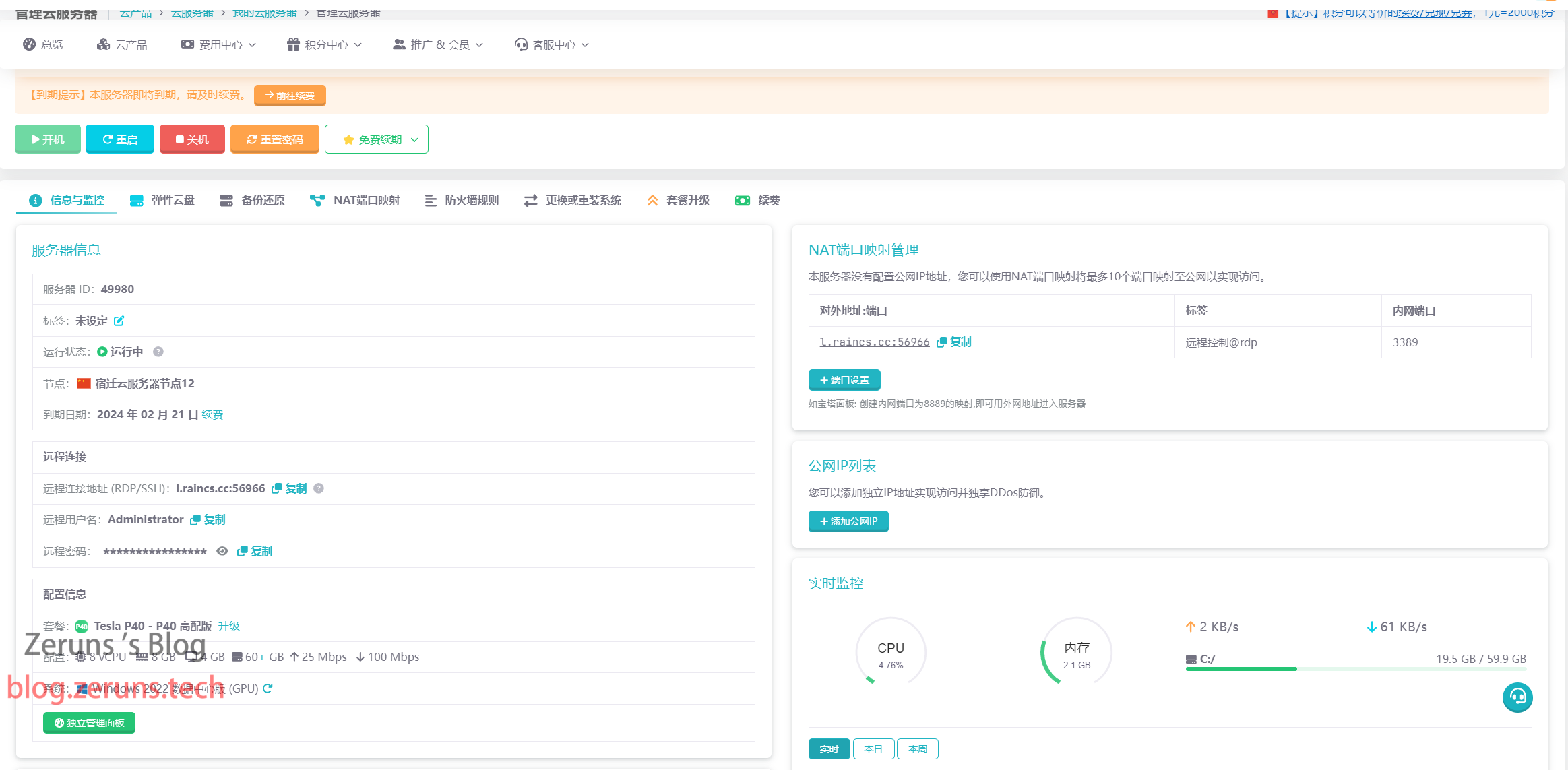

购买后即可在我的云服务器这里看到你买的VPS,点击这个卡片或者管理键。

接着就可以看到云服务器的信息了,在这里重装/切换系统,可以升级配置。

连接服务器

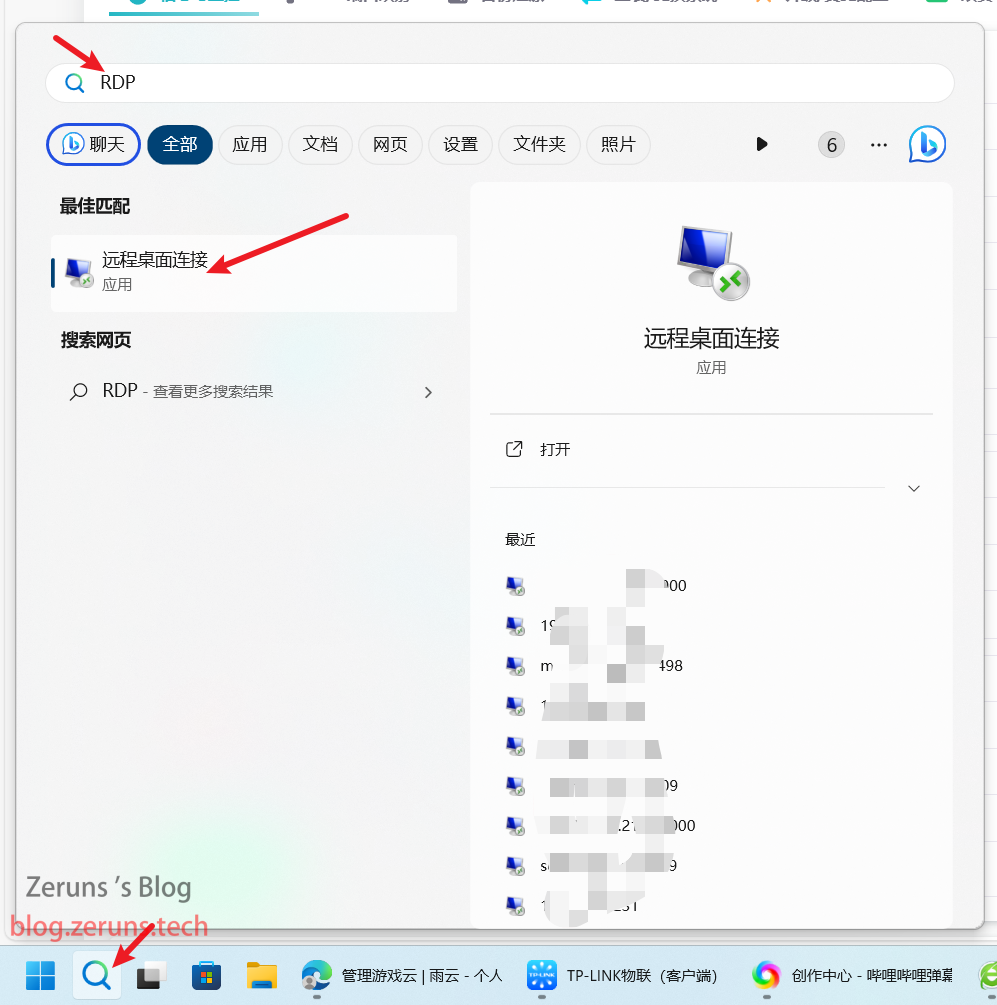

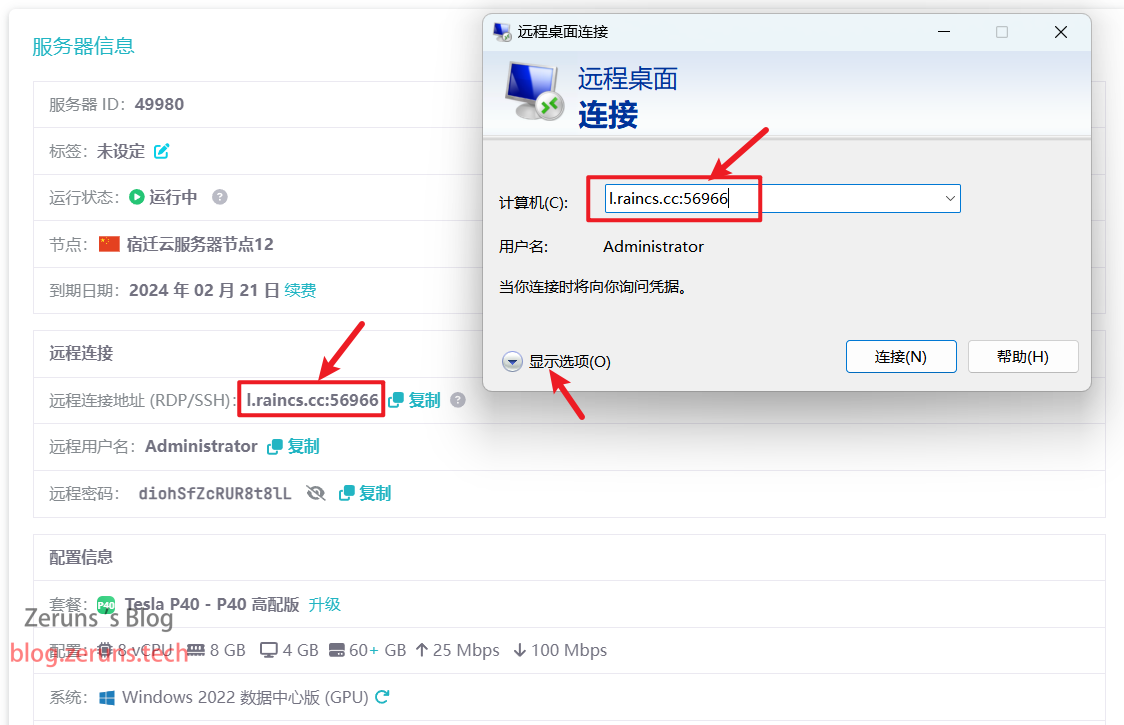

在自己电脑上打开windows自带的远程桌面软件(RDP)

输入你服务器的远程连接地址和端口(一般远程桌面的默认端口是3389,因为我选的NAT模式,共用公网IP,所以3389端口被映射到56966,你的不一定是这个端口,根据自己实际情况输入),点击显示选项。

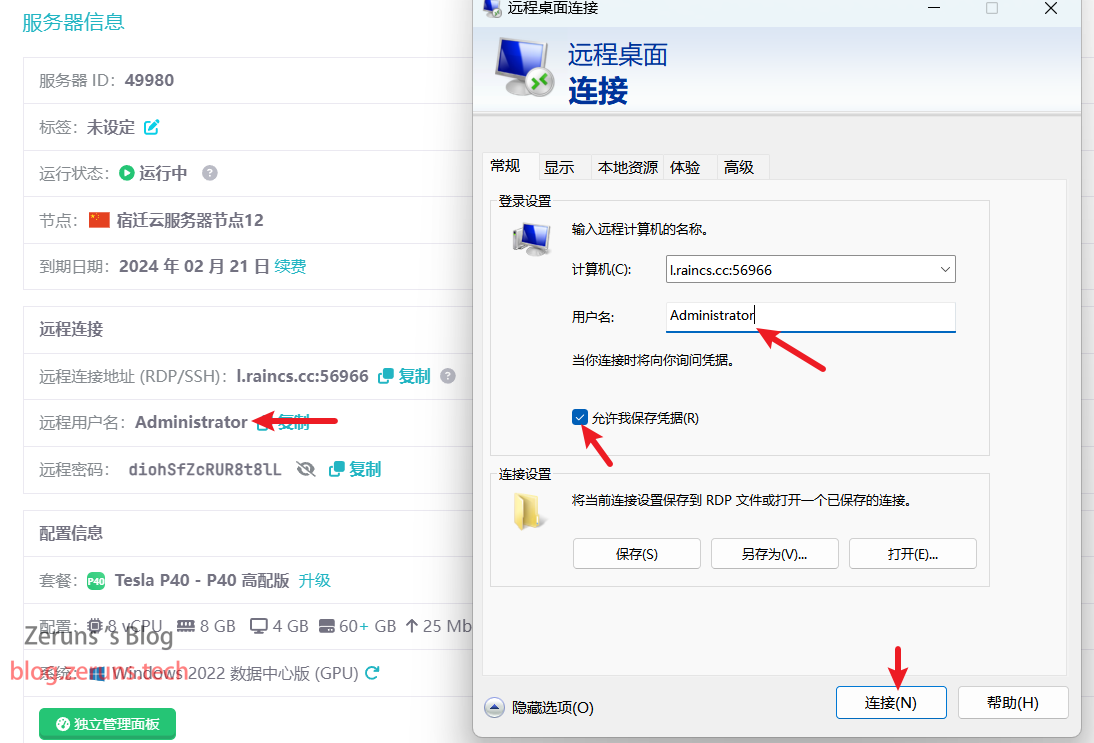

用户名输入默认的Administrator,然后点击连接。

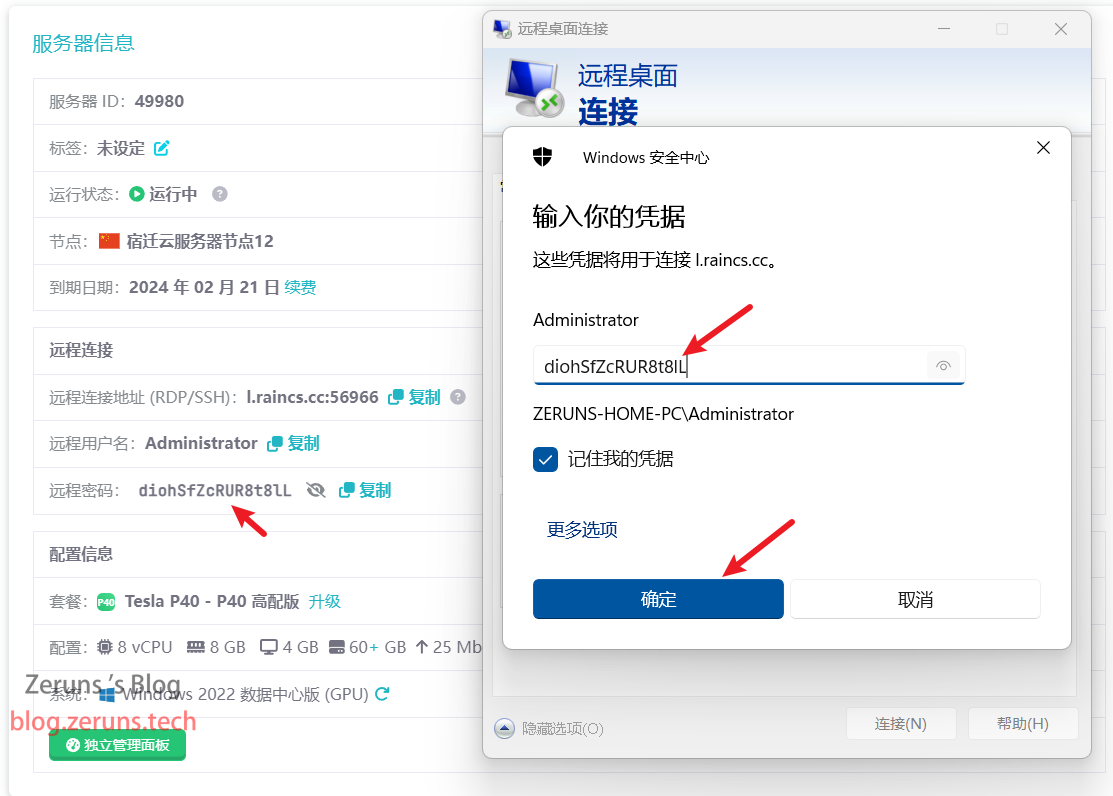

接着输入密码并确定。

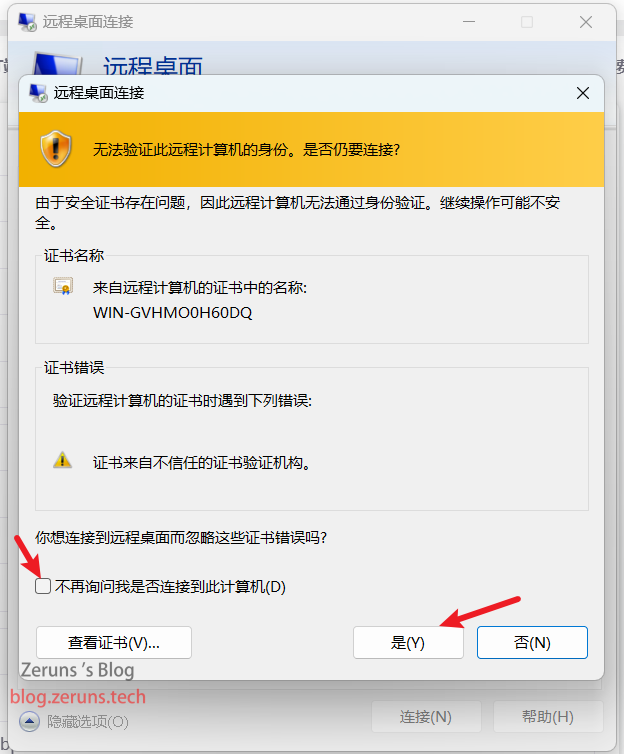

如果弹出这个框就直接点是

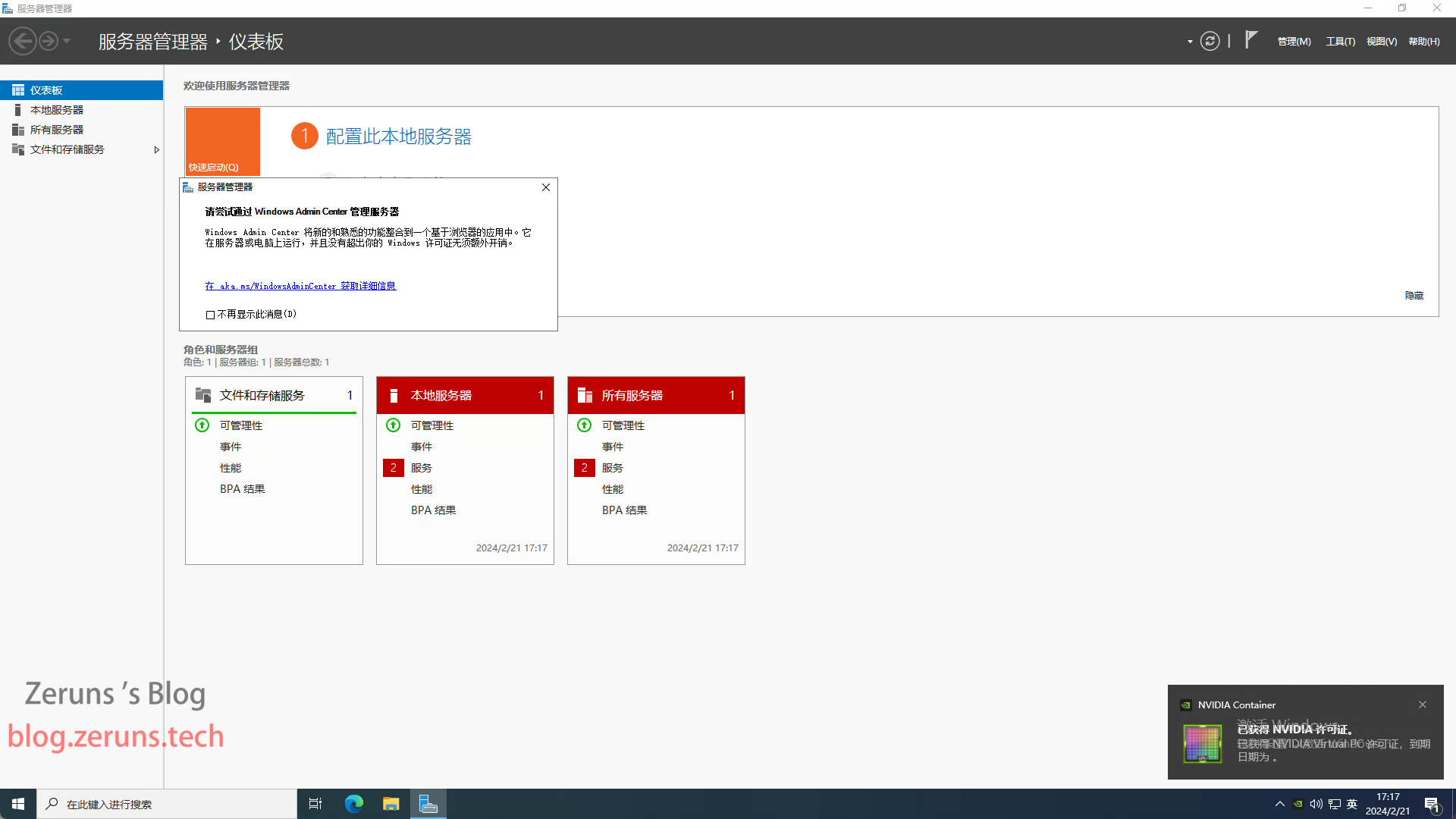

然后就连接上服务器了

GPT4All安装和使用

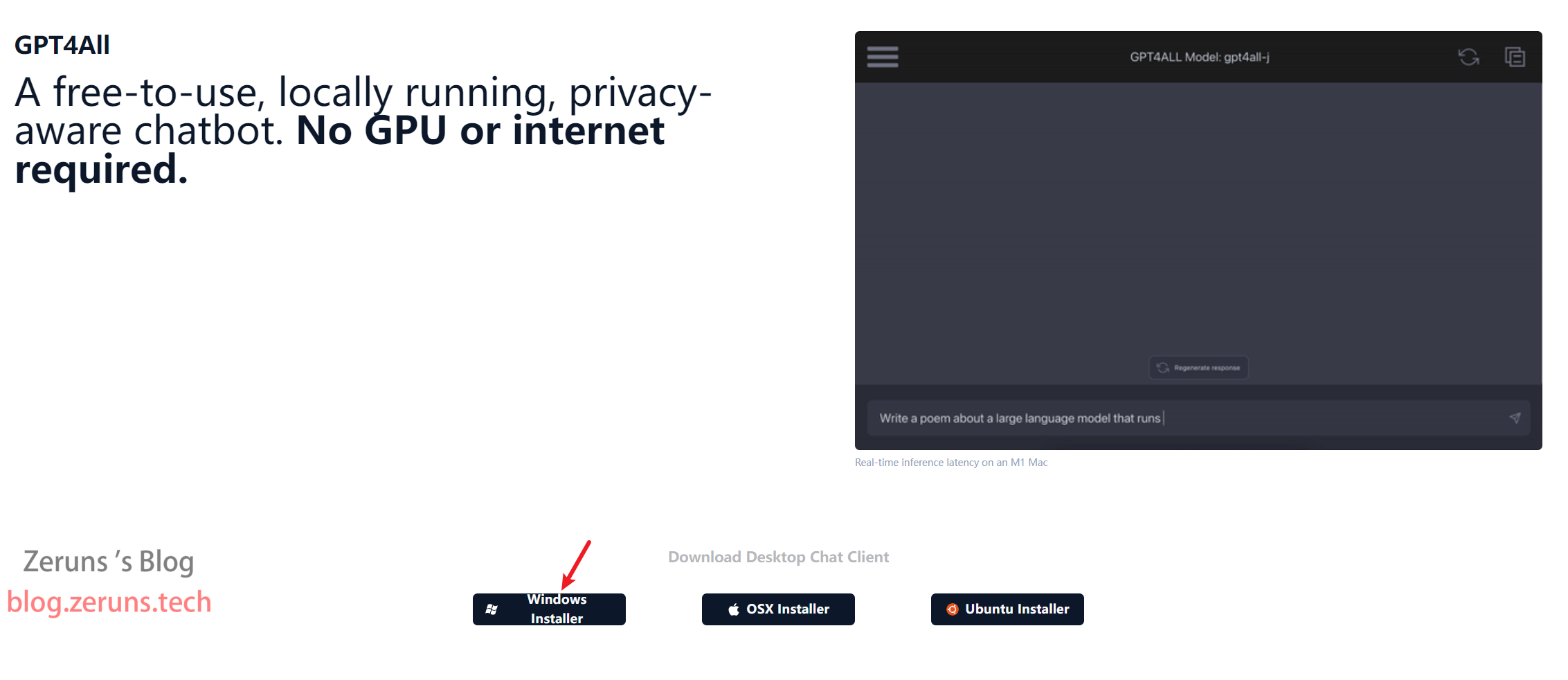

首先需要下载安装包到服务器里:

GPT4All官网:https://gpt4all.io

我这里下载了Windows版的安装包放网盘里了,如果进不去官网可以在这个链接下载:https://www.123pan.com/s/2Y9Djv-dMcvH.html

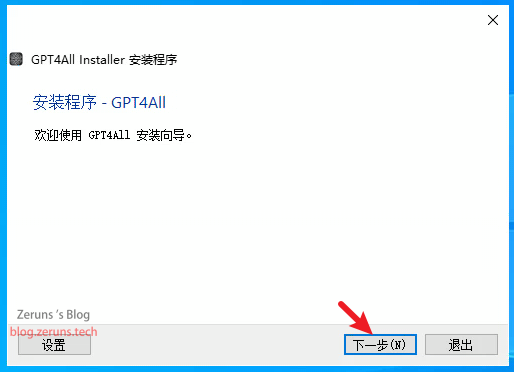

下载好后双击打开安装包,点击下一步。

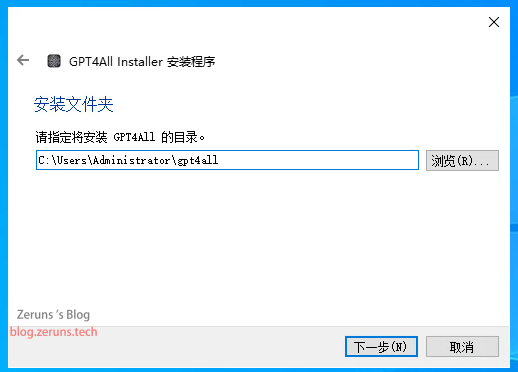

选择安装目录,默认就行,点击下一步。

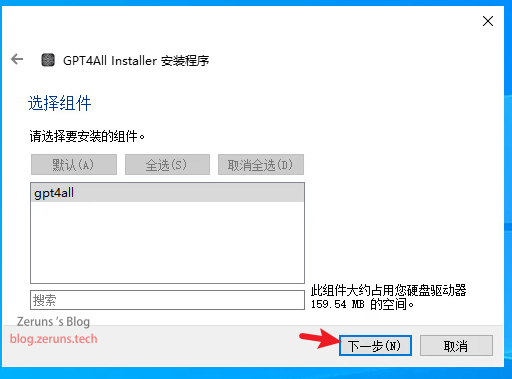

选择组件,直接点击下一步。

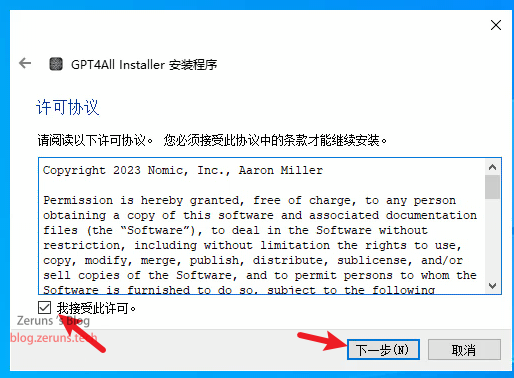

点击接受许可协议,下一步。

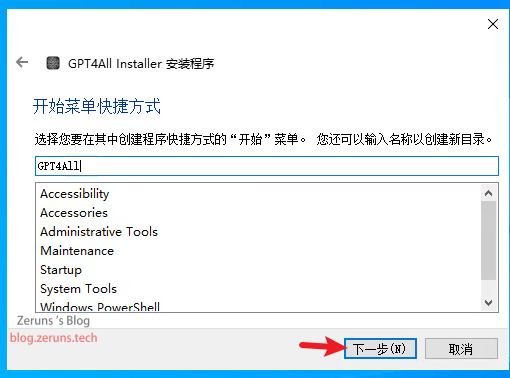

直接点击下一步。

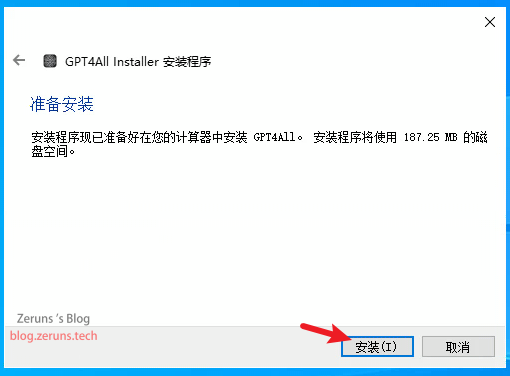

点击安装。

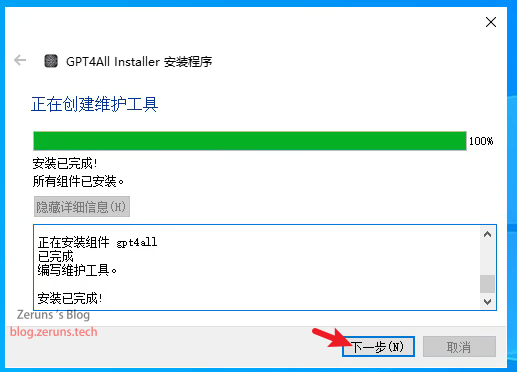

安装完成后点击下一步,再点击完成就行。

双击打开桌面这个GPT4All的图标

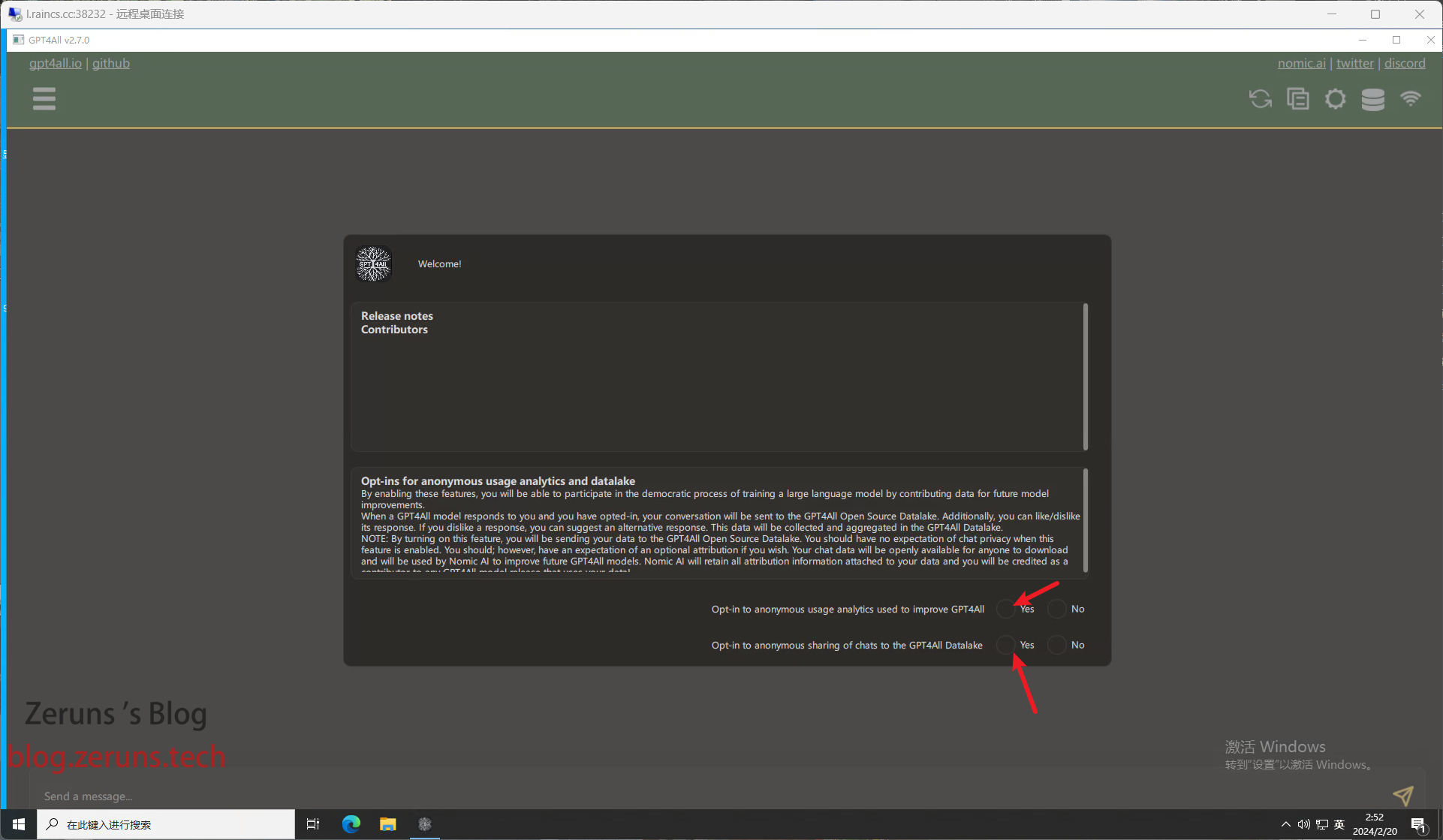

勾选这两个Yes

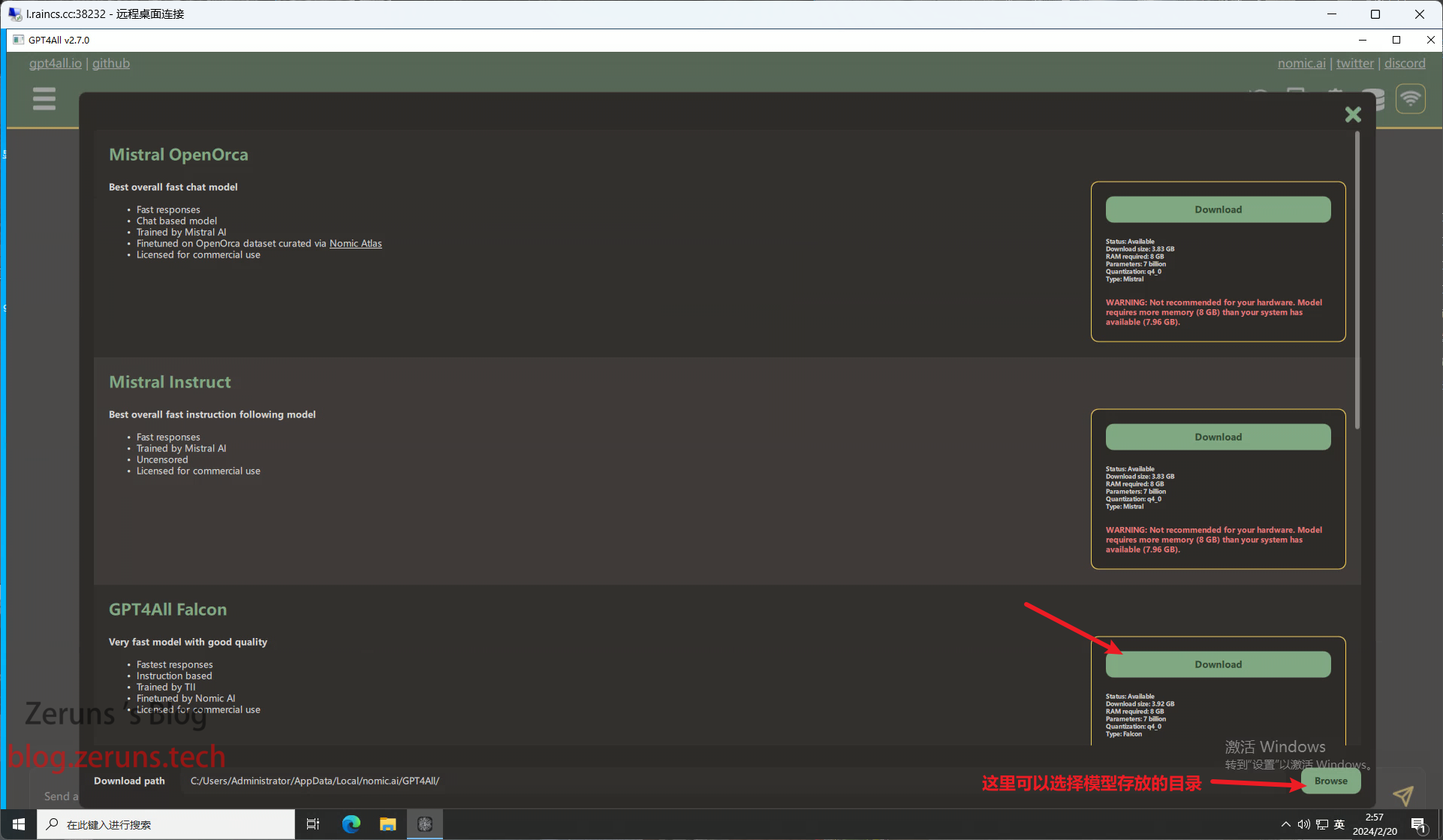

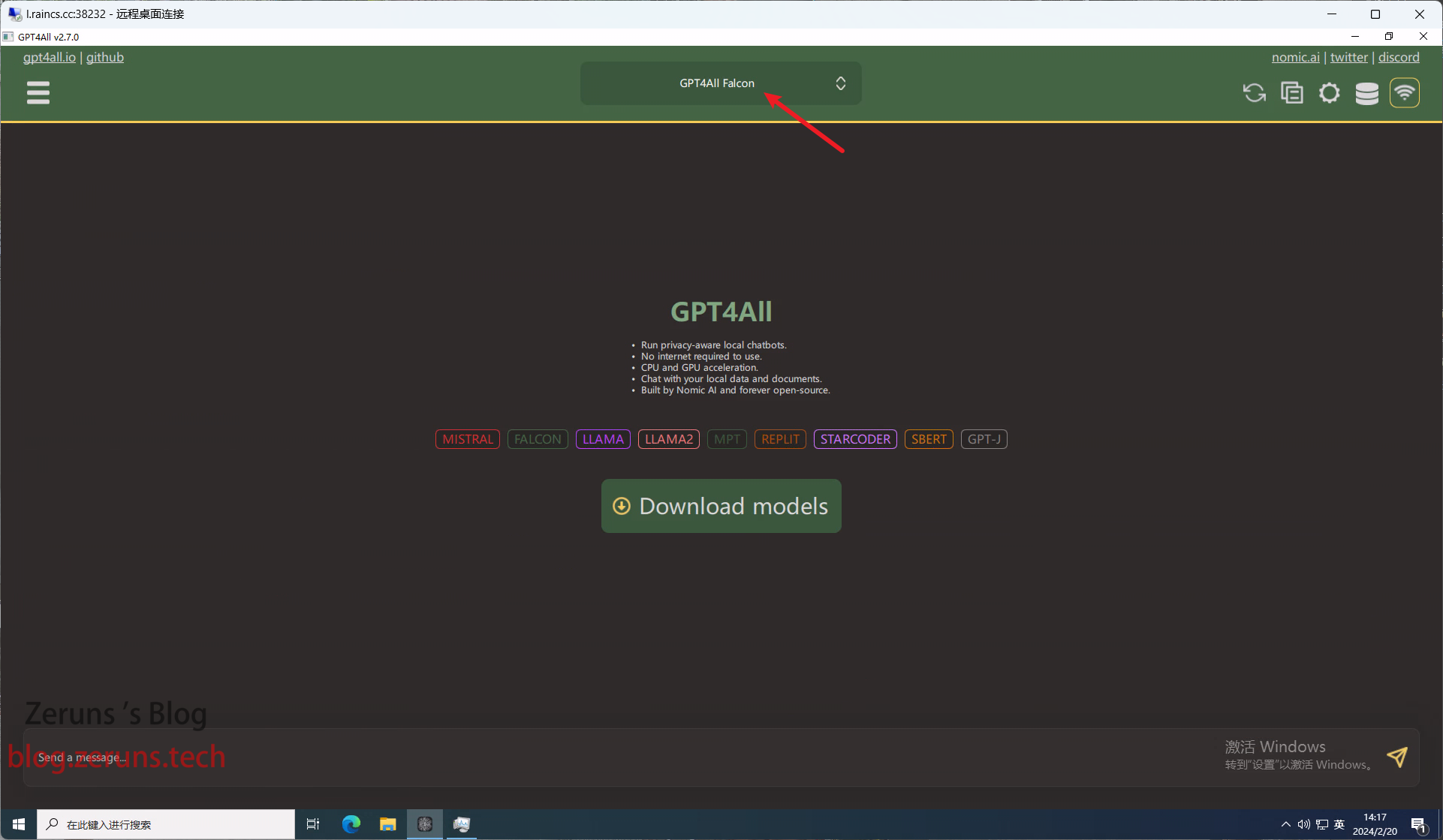

选择一个模型来下载,我这里选择GPT4AII Falcon。

注意:由于国内网络问题,所以需要你自己科学上网才能下载模型(只有获取模型列表时需要科学上网,模型列表加载出来后下载模型时可以关掉科学上网)。

也可以到官网自己下一个别的模型导入进去。

下载完成后关闭下载模型的窗口就可以看到聊天框了,聊天框上方可以选择要运行的模型。

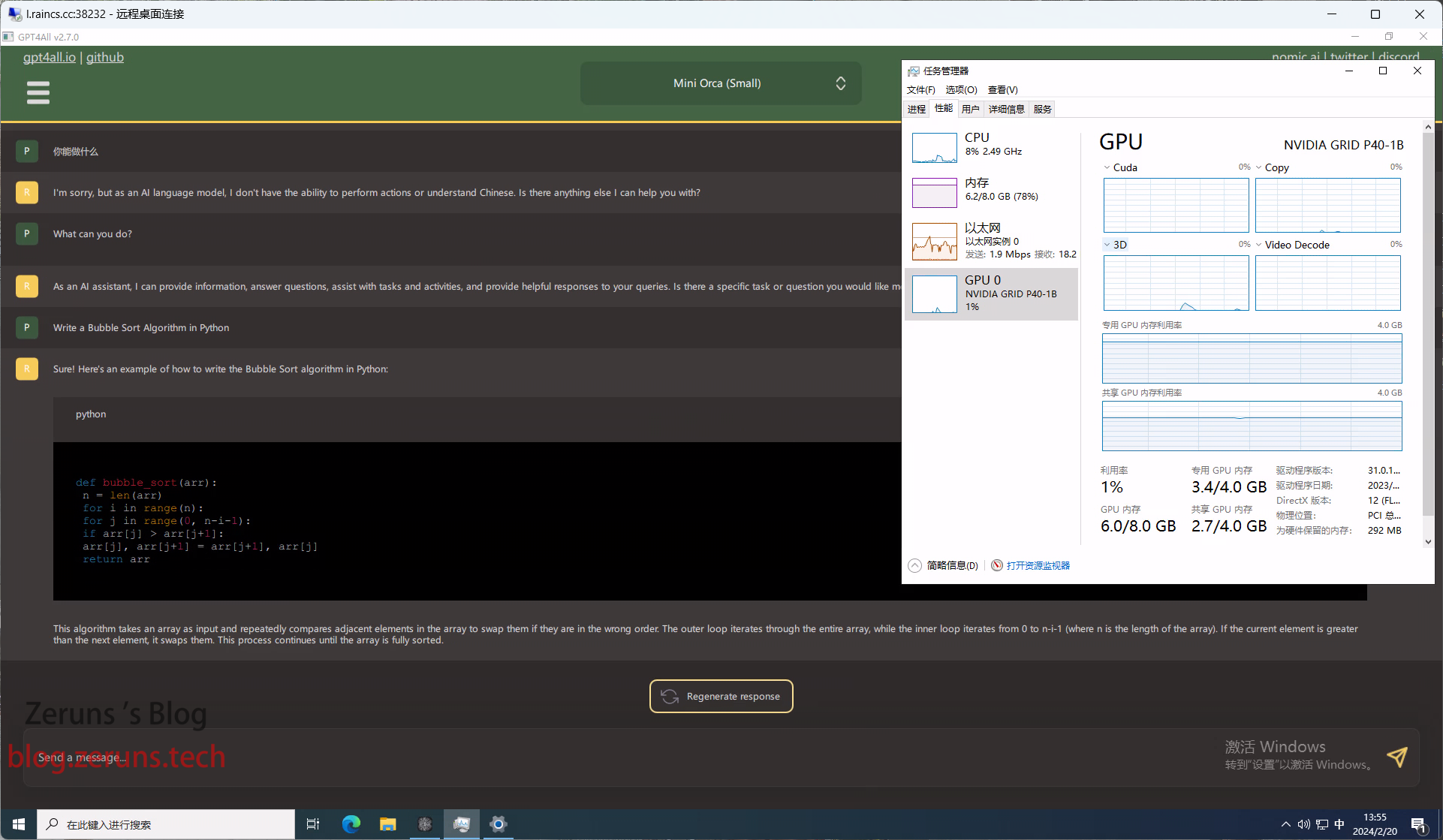

由于GPT4AII Falcon模型需要8G显存跑(也可以用CPU+内存来跑,不过速度慢很多),而我购买的机型是4G显存的,所以我这里改成选择Mini Orca(small)模型,这个模型仅需4G显存。

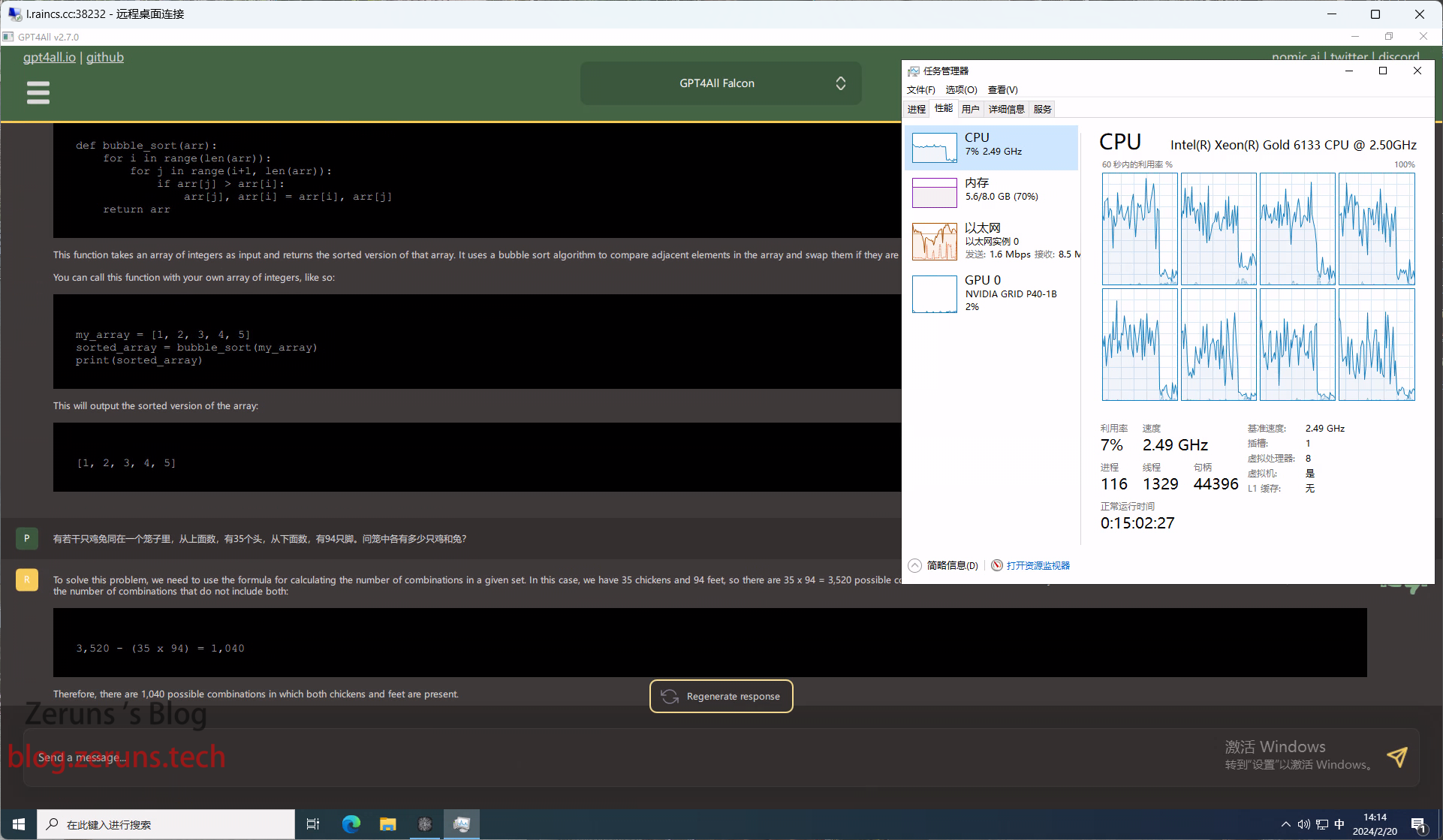

用CPU+内存跑GPT4AII Falcon模型。

推荐阅读

- 高性价比和便宜的VPS/云服务器推荐: https://blog.zeruns.com/archives/383.html

- 雨云服务器快速搭建Cloudreve网盘网站并挂载雨云对象存储的教程:https://blog.zeruns.com/archives/743.html

- 云服务器搭建Typecho个人博客网站,保姆级建站教程:https://blog.zeruns.com/archives/749.html

- 我的世界(MC)整合包开服教程,Pokehaan Craft 2整合包服务器搭建教程:https://blog.zeruns.com/archives/755.html

- 雨云服务器搭建内网穿透服务器教程,NPS搭建和使用教程:https://blog.zeruns.com/archives/741.html

- 雨云VPS搭建PalWorld服务器,幻兽帕鲁开服联机教程:https://blog.zeruns.com/archives/760.html